Meta anticipa nuovi strumenti di editing basati sull’intelligenza artificiale in arrivo su Facebook e Instagram, con i quali gli utenti saranno in grado di modificare immagini e generare videoclip utilizzando descrizioni di testo.

Nel frattempo YouTube ha condiviso uno sguardo ai suoi primi esperimenti musicali con l’intelligenza artificiale, presentando Dream Track for Shorts e altri strumenti sviluppati in collaborazione con Google DeepMind.

Meta anticipa nuovi strumenti di editing basati sull’IA per Facebook e Instagram

Il CEO di Meta Mark Zuckerberg ha annunciato due nuove funzionalità basate su Emu, il modello di intelligenza artificiale generativa dell’azienda per la creazione di immagini, che verranno integrate in Facebook e Instagram.

Il primo è “Emu Edit” e consentirà agli utenti di modificare con precisione le immagini in base agli input di testo, fornendo agli utenti senza alcuna esperienza di editing grafico un modo per rimuovere o sostituire oggetti e persone nelle foto, senza nemmeno selezionarli manualmente.

:no_upscale():format(webp)/cdn.vox-cdn.com/uploads/chorus_asset/file/25089534/Meta_Emu_image_editor.gif)

Il video dimostrativo suggerisce che sarà possibile digitare ad esempio “trasforma il cane in un panda” e Emu Edit sarà in grado di identificare il cane all’interno dell’immagine e applicare la modifica richiesta senza alterare il resto dell’immagine.

Il secondo strumento è “Emu Video” che secondo l’azienda può generare video da istruzioni di testo, immagini di riferimento o una combinazione di questi due input. Ecco alcuni esempi.

:no_upscale():format(webp)/cdn.vox-cdn.com/uploads/chorus_asset/file/25089536/Meta_Emu_Video_demo.gif)

Al momento non si sa ancora quando gli utenti potranno aspettarsi che queste nuove funzionalità di editing arrivino su Facebook o Instagram.

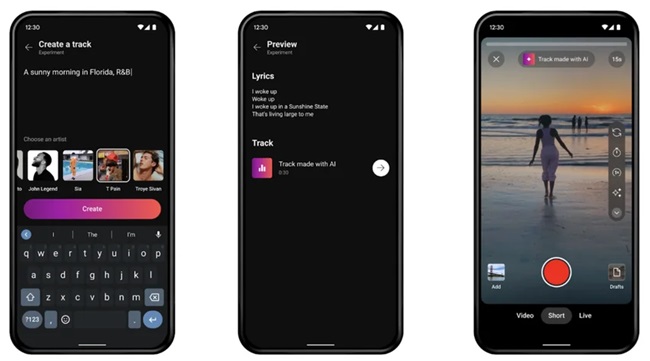

YouTube anticipa Dream Track for Shorts e gli strumenti di intelligenza artificiale musicale

Il team di YouTube ha annunciato che sta sperimentando la Dream Track basata su Lyria di Google DeepMind, il modello di generazione musicale più avanzato. Questo esperimento mira a esplorare come la tecnologia può approfondire le connessioni tra artisti, creatori e i loro fan.

Nove artisti, tra cui Alec Benjamin e Sia, stanno collaborando per dare forma al futuro dell’intelligenza artificiale nella musica, consentendo ai creatori statunitensi selezionati di generare colonne sonore uniche di 30 secondi per i loro Shorts utilizzando voci generate dall’intelligenza artificiale.

Inoltre, nel Music AI Incubator artisti, cantautori e produttori testano e forniscono feedback per sviluppare le migliori esperienze possibili per la comunità.

Le prime sessioni con i partecipanti hanno dato il via allo sviluppo di strumenti di intelligenza artificiale musicale, esplorando concetti innovativi. I potenziali strumenti verranno testati entro la fine dell’anno, offrendo nuove possibilità ai creatori.

Citando le solide relazioni con i partner dell’industria musicale, YouTube si impegna a esplorare in modo collaborativo nuove opportunità in questo ambito. La piattaforma ha inoltre fatto notare che è nelle prime fasi dell’intelligenza artificiale e dell’innovazione musicale e che sta evolvendo il suo approccio basato sull’apprendimento continuo, con l’obiettivo di costruire strumenti responsabili in grado di dare potere agli artisti, affascinare i fan e rispettare i limiti creativi.

Potrebbe interessarti: Xiaomi, Redmi e POCO, tante offerte interessanti con il Black Friday Amazon