È trascorso poco meno di un mese da quando vi avevamo parlato dell’importantissimo potenziamento di AI Mode conseguenti all’implementazione delle capacità multimodali di Google Lens, ma i tecnici di Mountain View non si sono fermati un attimo e anzi stanno preparando una nuova modalità conversazionale denominata “Live for AI Mode”.

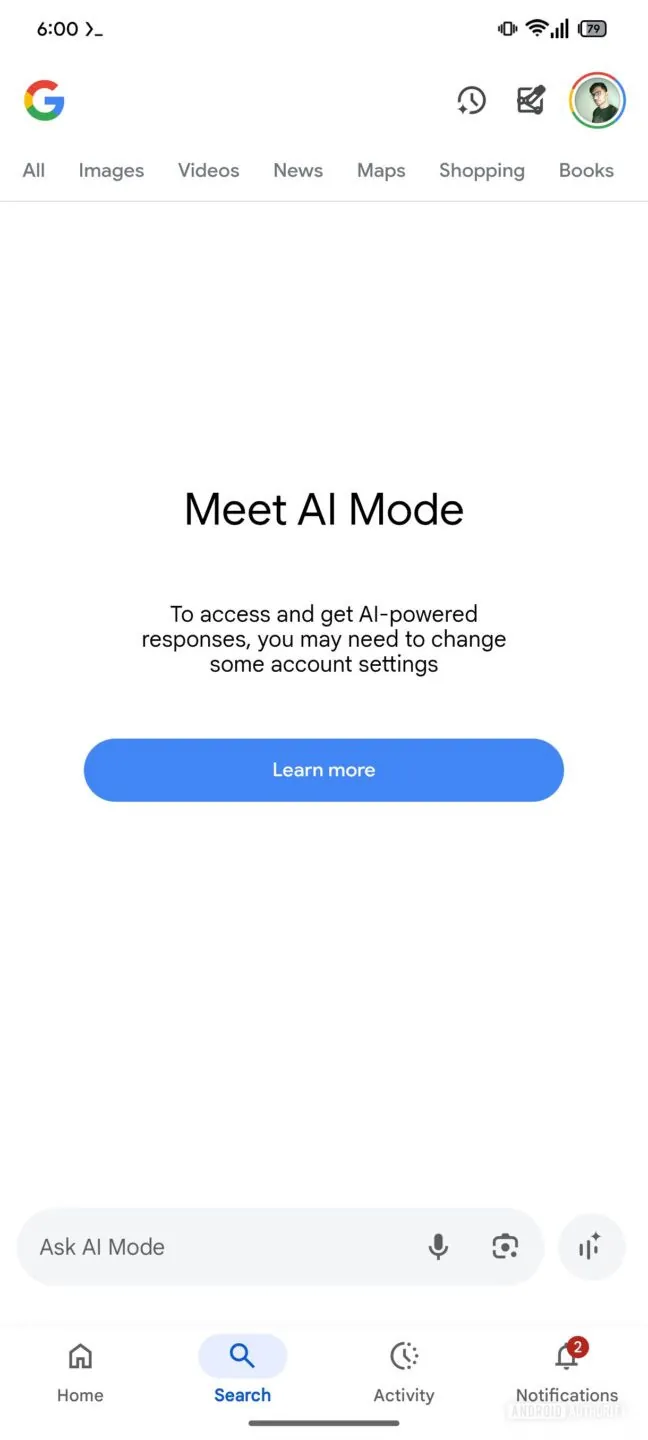

La AI Mode di Ricerca Google sta compiendo passi da gigante: nel giro di poche settimane, siamo passati da un accesso tramite lista d’attesa alla disponibilità per tutti negli Stati Uniti; contestualmente, sono state introdotte nuove funzioni per rendere lo strumento più utile — si veda il connubio con Google Lens menzionato in apertura — ed è stata portata avanti un’apprezzabile opera di affinamento grafico.

In questa sede parliamo di “Live for AI Mode”, che rappresenta per Ricerca Google l’equivalente di Project Astra per Gemini Live con una differenza sostanziale tutt’altro che trascurabile: il focus è sulla ricerca, piuttosto che sull’assistenza personale all’utente.

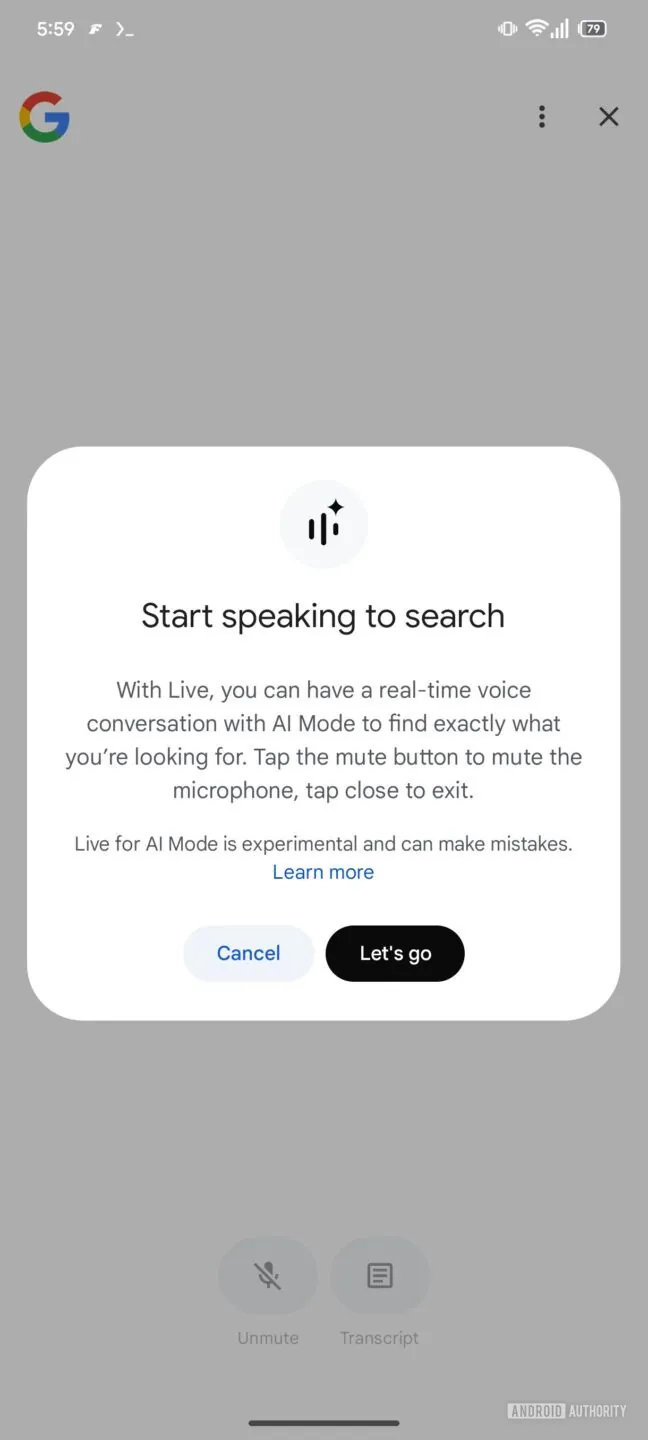

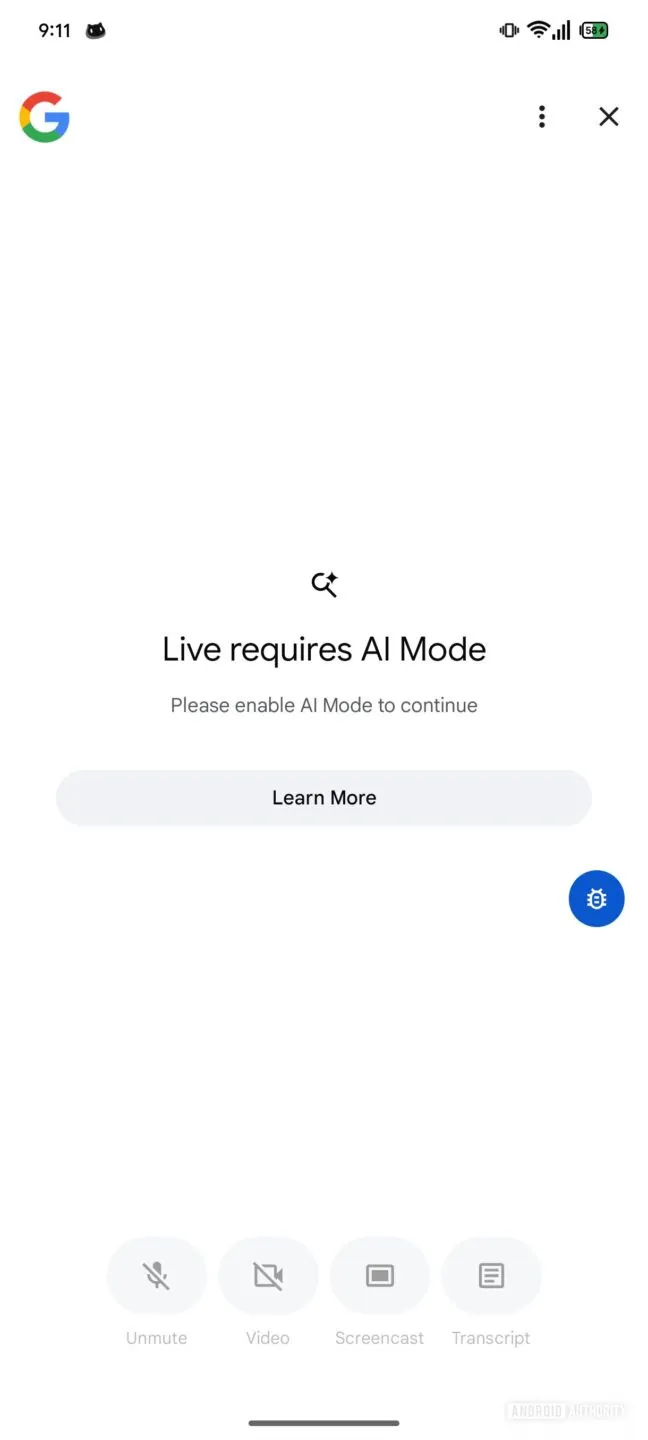

Le prime tracce di questa nuova capacità di AI Mode sono state avvistate nella versione beta 16.17.38.sa.arm64 dell’App Google, dove sono state indivuate righe di codice che spiegano come la modalità Live permetterà di avere delle conversazioni in tempo reale con AI Mode (“With Live, you can have a real-time voice conversation with AI Mode to find exactly what you’re looking for. Tap the mute button to mute the microphone, tap close to exit”). Il nome stesso della funzionalità — Live for AI Mode — è riportato nel disclaimer sulla possibilità di incappare in errori figli della natura ancora sperimentale della funzione (“Live for AI Mode is experimental and can make mistakes”).

<string name=”lens_live_error_labs_unenrolled_title”>Live requires AI Mode</string>

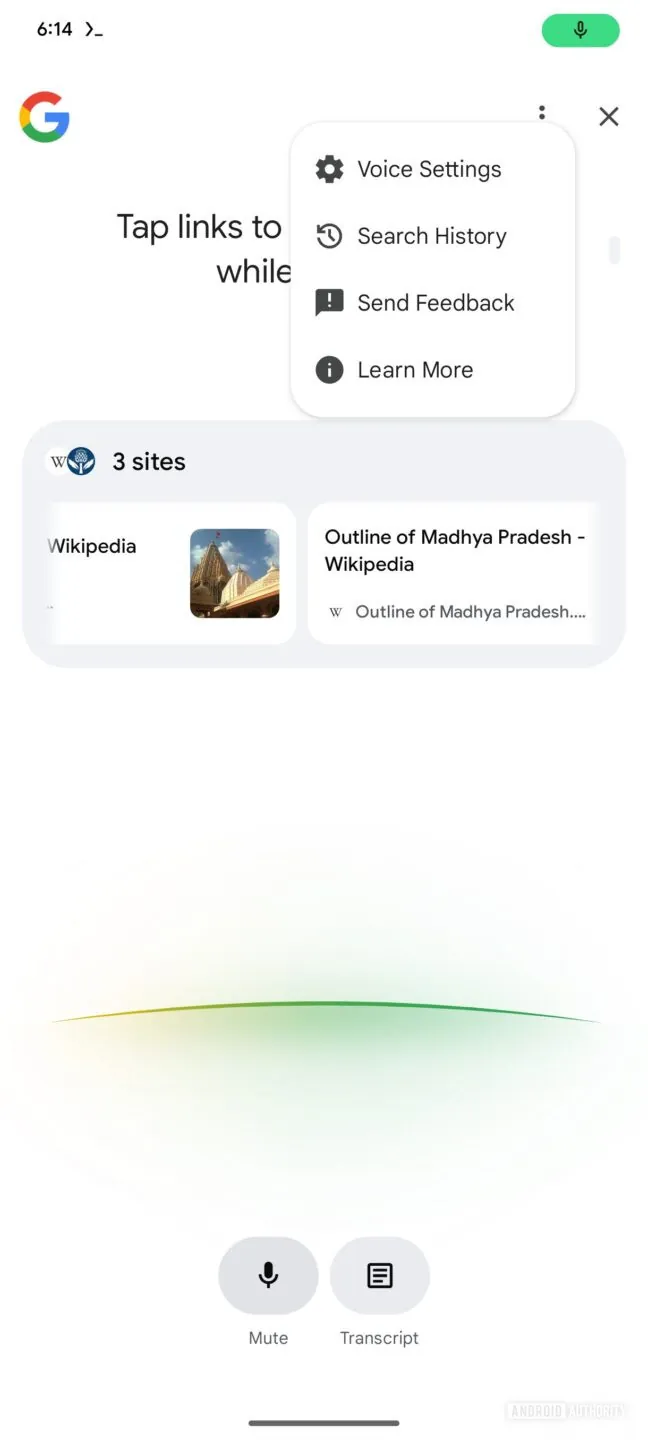

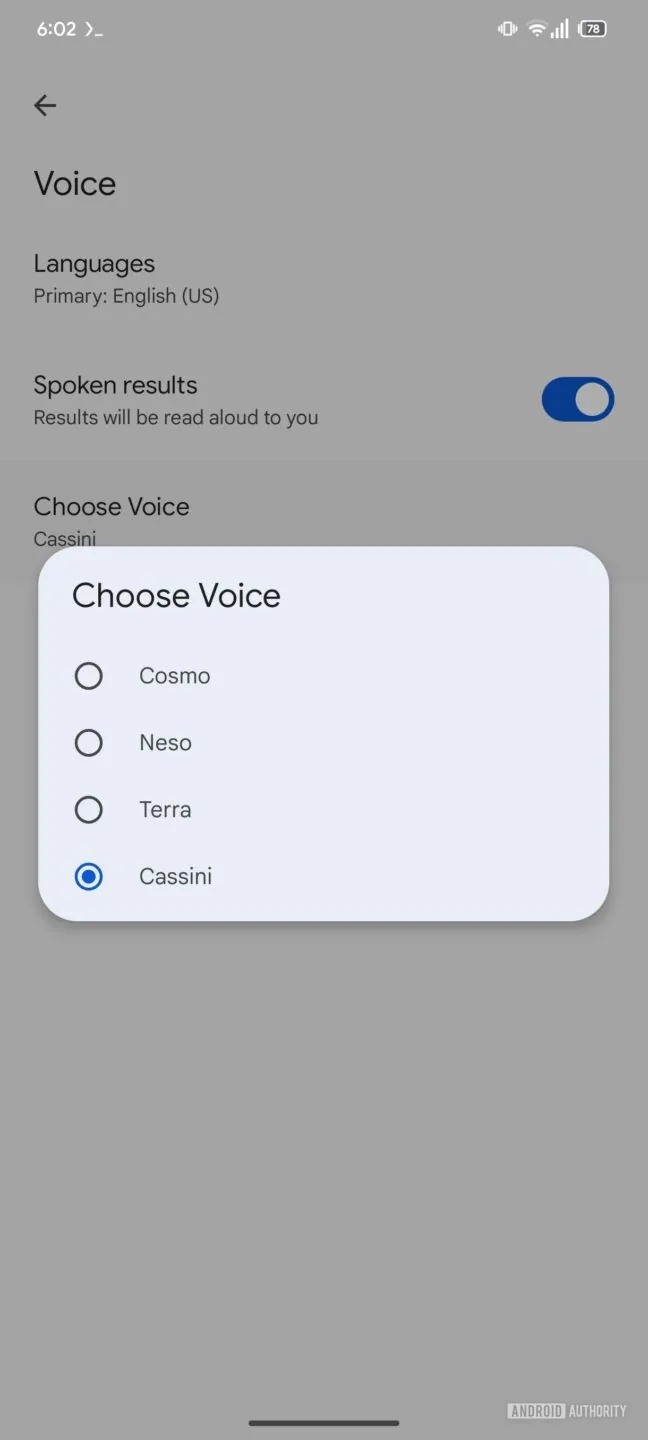

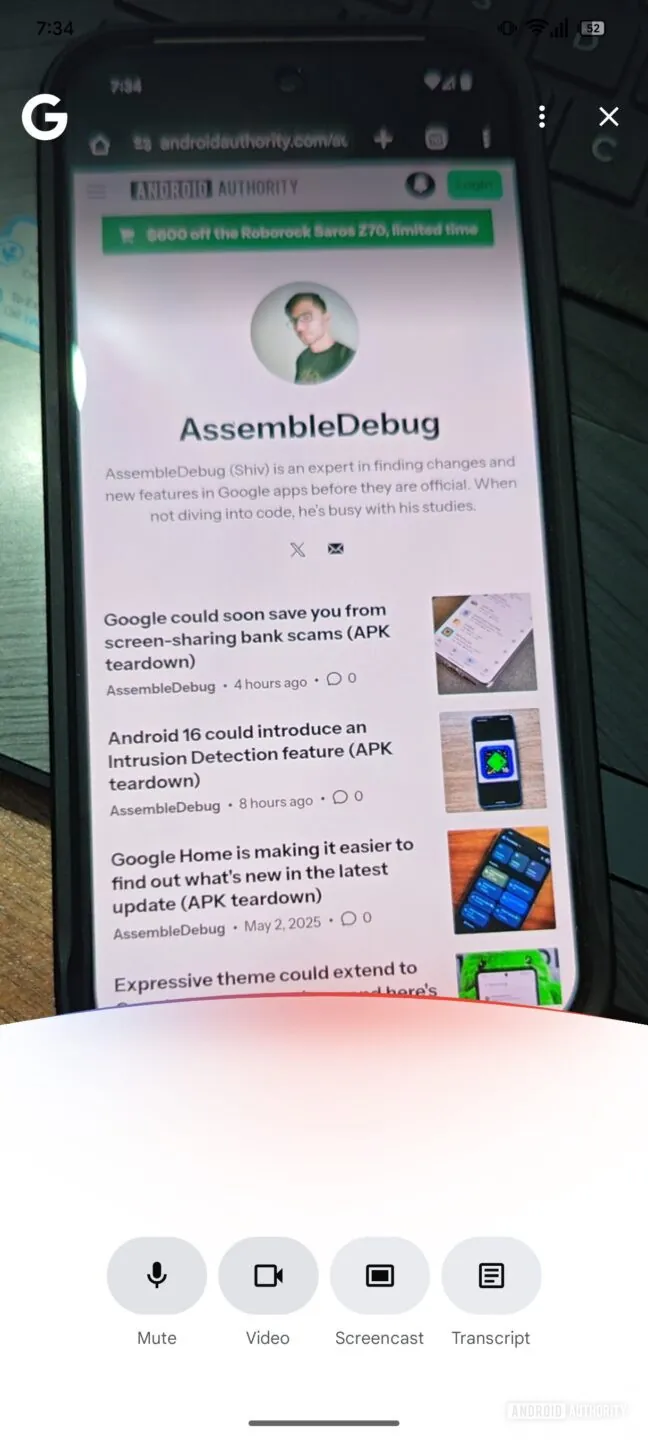

Come si vede dagli screenshot, l’icona Live appare alla destra del campo di inserimento dell’AI Mode, dunque la modalità conversazionale è sempre ad un tocco di distanza. Sono presenti anche le quattro voci di AI Mode di cui si era parlato nelle scorse settimane, non più abbinate ai nomi in codice bensì a quelli che potrebbero essere i nomi definitivi.

È interessante notare come il team di Google stia lavorando per integrare Live in Lens:

- <string name=”lens_live_onboarding_title”>Start speaking to search</string>

- <string name=”lens_live_volume_error_subtitle”>To start searching and hear results, raise the volume on your device</string>

- <string name=”lens_live_wave_tap_view_description”>Tap to interrupt response playback.</string>

- <string name=”lens_live_web_corroborations_termination_message”>”It’s not possible to ask a follow up question. Your next question will start a new search.”</string>.

Alla stregua di quanto avviene con Gemini Live, anche in questo caso Big G prevede di suggerire all’utente di alzare il volume, di informarlo della possibilità di interrompere le risposte in qualsiasi momento e di usare una notifica apposita per segnalare quando la funzione Live è in uso:

- <string name=”lens_live_notification_channel_name”>Live</string>

- <string name=”lens_live_notification_end_session_button”>End session</string>

- <string name=”lens_live_notification_mute_button”>Turn off microphone</string>.

L’integrazione con Google Lens implica che la modalità conversazionale di ricerca Live for AI Mode opererà prima di tutto sfruttando la fotocamera, ma non esaurirà qui i suoi scenari di utilizzo: gli utenti avranno anche la possibilità di condividere lo schermo:

- <string name=”lens_live_controls_screencast”>Screencast</string>

- <string name=”lens_live_controls_video”>Video</string>.

Sulla scorta di ciò, il team di Big G sta studiando anche la possibilità di attivare la funzione di Trascrizione, che consentirebbe all’intelligenza artificiale di leggere le conversazioni in corso, così da arricchire l’esperienza dell’utente con suggerimenti di link per effettuare ricerche in rete mentre si chatta:

- <string name=”lens_live_coachmark_ecosystem”>Tap links to explore the web while you chat</string>

- <string name=”lens_live_coachmark_mute”>Tap \\”unmute\\” to resume chatting</string>

- <string name=”lens_live_coachmark_responding”>Speak or tap the wave to interrupt</string>

- <string name=”lens_live_coachmark_transcript”>Tap \\”transcript\\” to read your conversations</string>

- <string name=”lens_live_controls_disable_video_button_description”>Disable video</string>

- <string name=”lens_live_controls_enable_video_button_description”>Enable video</string>.

Giunti alle note conclusive, è importante ricordare che queste anticipazioni ci permettono soltanto di conoscere le novità sviluppate e prese in considerazione dal team di Mountain View, tuttavia non ci offrono alcuna certezza sulla loro effettiva futura introduzione, né tantomeno ci permettono di azzardare previsioni sulle tempistiche di un eventuale rilascio.