Il team di Instagram ha appena rilasciato due nuove funzionalità con l’obiettivo di frenare il bullismo sulla piattaforma social: un avvertimento quando si tenta di pubblicare un commento potenzialmente violento oppure offensivo e una funzione per limitare alcuni utenti rendendo i loro commenti visibili solo a loro stessi.

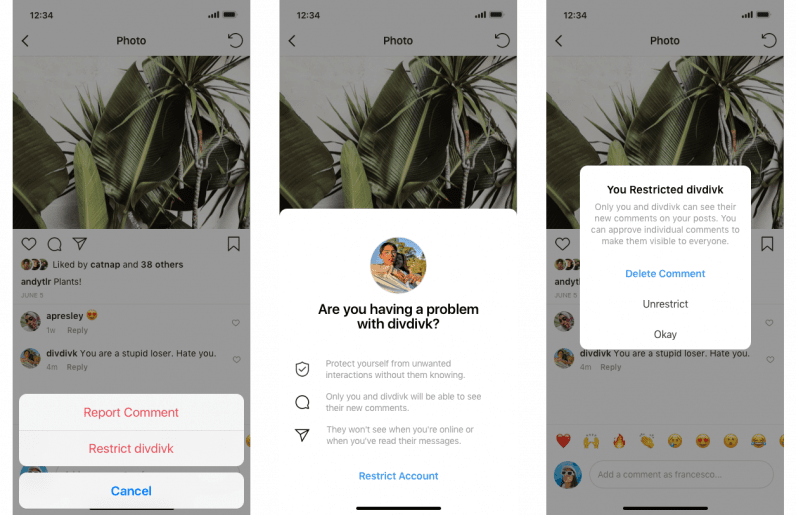

La facoltà di limitare un utente è operativa anche quando l’altra persona è attiva su Instagram o quando viene letto un messaggio diretto, in modo da mettere in ombra il molestatore.

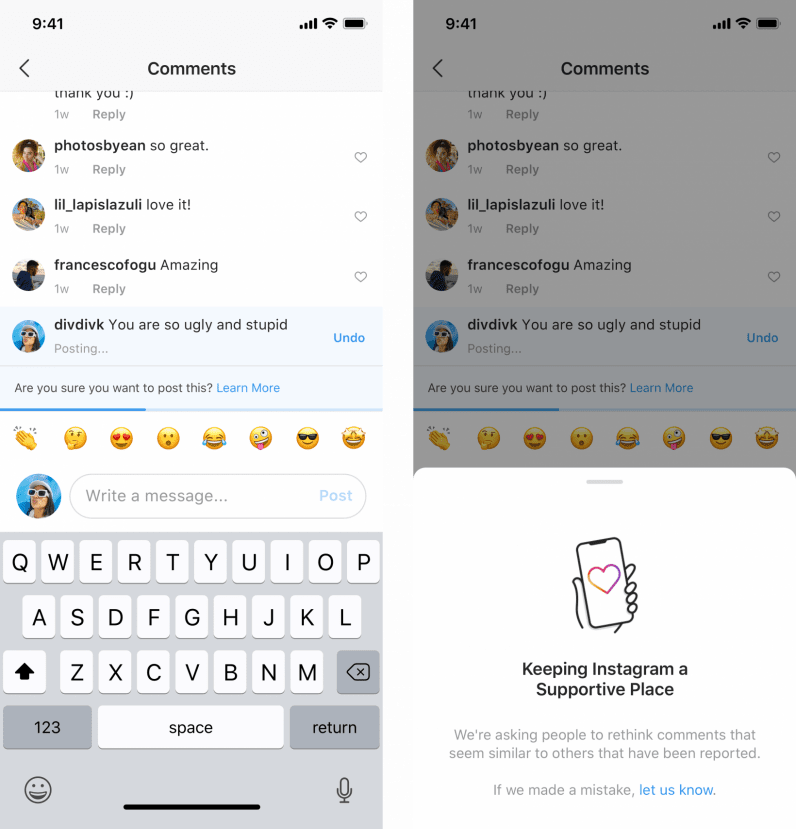

La nuova funzionalità basata su AI che avvisa le persone quando il loro commento può essere considerato offensivo ha lo scopo di incoraggiare le persone a riflettere un attimo prima di pubblicarlo ed eventualmente aiutarli a valutare se annullare o modificare il loro commento.

Certe funzionalità sono necessarie per frenare il bullismo in maniera più immediata rispetto a segnalare un account, anche se spesso i molestatori ricorrono a vari trucchi come l’utilizzo di simboli o grafie alternative per ingannare l’intelligenza artificiale e postare commenti offensivi, ma almeno ora avranno la possibilità di riflettere prima di pubblicare. Instagram non ha specificato se la funzione è disponibile per le lingue diverse dall’inglese.