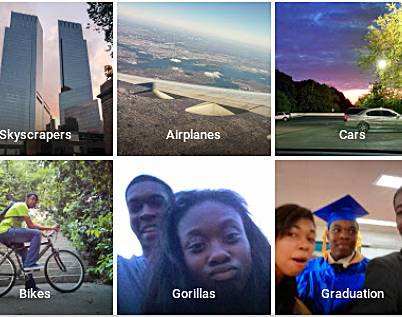

Correva il 2015 e Google Foto era stato messo sotto ai riflettori per un caso davvero incredibile: il riconoscimento automatico delle foto aveva identificato e categorizzato il volto di persone afroamericane sotto la categoria “gorilla”.

Oltre ad essere assolutamente razzista, il problema aveva lasciato molto da pensare su ciò che è su cosa comporta l’utilizzo dell’intelligenza artificiale e Google aveva messo una pezza semplicemente bloccando la categoria. Oggi, dopo 3 anni, BigG sembra non essere ancora riuscita a risolvere completamente il problema.

A quanto pare, infatti, questo periodo non è bastato per far fare un passo in avanti all’AI dietro Google Foto, e la categoria “gorilla” (ma anche “scimpanzé” e “scimmia”) rimane tutt’ora bloccata: una pezza bella e buona, che non rappresenta però una soluzione.

Google avrebbe inoltre ristretto il funzionamento del suo algoritmo per prevenire altri scandali, e ad esempio una ricerca per “black man” o “black woman” fornisce come risultato immagini di persone in bianco e nero, sorteggiate per genere ma non per colore della pelle.

Questo blocco, un po’ troppo semplicistico, sottolinea ancora una volta quanto sia difficile addestrare un’intelligenza artificiale per essere robusta a tal punto da risultare effettivamente intelligente.

Secondo voi la scelta di mantenere il blocco (andando quindi di fatto a limitare la funzionalità dell’algoritmo) rappresenta la volontà di non spendere risorse per trovare una vera soluzione o semplicemente una barriera ulteriore per evitare ogni possibilità di scandalo? Diteci la vostra con un commento qui sotto.