C’è chi l’ha scoperto tramite un amico che ha scelto uno dei tanti porting disponibili per conferire nuova linfa vitale alla fotocamera dello smartphone ormai nel cassetto da anni, chi per mezzo di un collega che ha acquistato un Google Pixel, chi da una notizia su TuttoAndroid.

Non sono mancate insomma le occasioni per conoscere Google Fotocamera, il software fotografico di Mountain View che in breve tempo è divenuto il più ambito grazie alle “magie” di cui ha dato prova in svariate occasioni. Lo sviluppo comincia nel 2011 per mano di un team guidato da Marc Levoy, colui che il mese scorso sul palco di Made by Google ha esaltato le capacità fotografiche di Google Pixel 4 e Pixel 4 XL.

Il debutto di Google Fotocamera sul Play Store avviene tre anni più tardi e da allora le evoluzioni che hanno portato al prodotto odierno si sono susseguite senza soluzione di continuità. Vogliamo scoprire insieme a voi cos’è che ha reso e rende Google Fotocamera il miglior software fotografico su piazza, quasi imprescindibile se si vuole tirar fuori il massimo dalla fotocamera del proprio smartphone con una semplicità disarmante.

Google Fotocamera e la semplicità, un legame proficuo

La stella che ha guidato e continua a guidare Google nello sviluppo del suo software è proprio l’immediatezza con cui si ottengono foto di prim’ordine: sul punta e scatta, se si escludono gli smartphone della Mela, non ci sono rivali. La principale caratteristica di Google Fotocamera è proprio quella di richiedere all’utente un contributo nullo al prodotto finale o comunque limitato alla selezione della modalità più appropriata e ad un paio di altri aspetti che vedremo tra un momento. Che gli automatismi possano essere semplificati ulteriormente l’ha palesato la concorrenza – Apple – che ad esempio ha consegnato nelle mani del software l’attivazione della Modalità Notte, mentre sulla Google Fotocamera è l’utente a decidere quando è conveniente utilizzarla. Nulla che Google non possa integrare in futuro con un allenamento degli algoritmi e un aggiornamento, intendiamoci, ma la strada verso la perfezione passa anche da finezze come queste.

Anche volendo però i margini per firmare uno scatto sono ridotti al lumicino. Nessun intervento “umano” ad esempio è concesso sul tempo di esposizione o sul bilanciamento del bianco e più in genere su ogni altro settaggio che trovate all’interno di un qualsiasi software fotografico in modalità avanzata. Le uniche concessioni all’utente riguardano il punto di messa a fuoco, la regolazione dell’intensità delle luci e, a partire dai Pixel 4, anche delle ombre. Ne risulta che Google Fotocamera è il software ideale per coloro che non hanno particolari competenze fotografiche, specie se utilizzato su un Pixel: per citare un esempio ricorrente del nostro recensore Matteo Virgilio, 100 tentativi di scatto su un Google Pixel generano 99 foto da tenere in memoria. Ed è ciò che fa la differenza.

Google Fotocamera ed i Pixel, simbiosi tra hardware e software

Detto della semplicità d’uso, merito indiscutibile dell’efficacia degli algoritmi di Google, cos’è che rende desiderabile Google Fotocamera? Di certo non può esaurirsi tutto a questo, anche se è l’aspetto principale. E infatti c’è molto altro.

Nota bene prima di proseguire: condurremo l’analisi sul software realizzato da Google per i Pixel, ma come anticipato in apertura il lavoro di molti sviluppatori ha prodotto altrettanti porting per quasi tutti gli smartphone Android con l’API Camera 2 abilitata, e lo è su gran parte dei prodotti recenti. Per approfondire la questione vi consigliamo la lettura di questo articolo.

La spiccata attitudine per la fotografia degli smartphone di Google e l’esperienza complessiva di scatto servita all’utente non derivano esclusivamente da Google Fotocamera. Se queste due componenti stazionano ai vertici del settore parte del merito è da attribuire all’hardware che a Mountain View hanno individuato per sbrigare tempestivamente le direttive del software. Già dal primo Pixel Google ha sperimentato i benefici degli acceleratori hardware per l’elaborazione dell’immagine: nel 2016 si è fatto ricorso ad un DSP di Qualcomm e alla GPU Adreno, ma è con i Pixel di seconda generazione che si è passati al livello successivo con l’esordio del Pixel Visual Core, un processore dedicato all’elaborazione foto e video – peraltro progettato in casa – poi confermato sui Google Pixel 3 ed evoluto sui successivi in Pixel Neural Core, in modo che potesse anche abbracciare compiti di machine learning.

Il lavoro dell’HDR+

Grazie alla potenza in più di quest’ultimo Google ha dotato i Pixel 4 Google del Live HDR, che dà modo all’utente di apprezzare già in fase di inquadratura la resa finale di foto o video. Alla base c’è comunque il più efficace HDR+ su piazza che cattura degli scatti in sequenza e li combina con tecniche di fotografia computazionale per ottenere un range dinamico migliore, una riduzione puntuale del rumore e dei colori vivi e brillanti a prescindere dalla luminosità ambientale. All’alto livello dei video filmati con Google Fotocamera si arriva anche attraverso la cosiddetta stabilizzazione ibrida dell’immagine, ossia quella che combina la stabilizzazione ottica del sensore, quindi “meccanica”, e quella digitale, da sempre tra i punti di forza del software di Mountain View: OIS ed EIS insieme danno luogo a clip difficilmente pareggiabili dalla concorrenza in quanto a fluidità e piacevolezza.

Le numerose funzioni di Google Fotocamera

Tutto molto bello sin qui: qualità e semplicità. Ma le funzioni? Non mancano neanche quelle. A cominciare dal Super Res Zoom, una vera e propria dimostrazione di forza resasi necessaria un anno fa quando il gigante californiano ha remato controcorrente per l’ennesima volta mantenendo la singola fotocamera sul retro dei Google Pixel 3, nonostante il settore smartphone – da tempo – si stesse muovendo compatto nella direzione opposta. “[La seconda lente] l’abbiamo ritenuta non necessaria” ha confessato qualche giorno dopo a Wired il vice presidente di Google Mario Queiroz. Dunque per rivaleggiare ad armi pari con la concorrenza nonostante l’obiettivo in meno ci si è affidati al Super Res Zoom, un espediente che porta su smartphone la tecnica di interpolazione delle immagini chiamata drizzle in modo da ottenere zoom fino a 2-3x di qualità simile a quella di un’ottica dedicata. Con il teleobiettivo da 1,8x dei Pixel 4 e il Super Res Zoom, sempre a detta di Google, ci si può spingere fino all’8x (ma qualcuno è arrivato anche a 16x).

Panorama notturno con Modalità Notte

Parlando di primizie software non si può ignorare Night Sight o Modalità Notte, com’è stata tradotta in Italia. Nessuno prima di novembre 2018 immaginava che dei sensori meno estesi di un’unghia potessero dar vita a certi scatti in condizioni di luce proibitive. E invece Google Fotocamera coi Pixel 3 ha suonato la carica all’intero settore smartphone, rimanendo per molti mesi leader incontrastata nelle foto in condizioni di buio pressoché totale. In certi casi oggi quel gap è stato colmato, ma grazie ai porting la Modalità Notte di Google Fotocamera può operare con risultati ottimi anche su prodotti di fascia media, mettendo in luce una flessibilità non da poco. Il segreto della modalità va ricercato ancora una volta negli algoritmi di Google, più nello specifico in quelli che governano HDR+ e Super Res Zoom: pensate che il processore d’immagine dei Pixel talvolta riceve fino a 15 scatti da 1/15 di secondo come tempo di posa oppure, a seconda di quel che il software reputa più opportuno, fino a 6 immagini da 1 secondo, per un tempo di esposizione complessivo di 6 secondi. E non è finita qui perché ciascun frame può essere diviso anche in 12.000 frammenti pur di ottenere il risultato migliore. La Modalità Notte di Google Fotocamera funziona a dovere anche quando la luce c’è ma non è troppa migliorando comunque il bilanciamento del bianco, la vivacità e riducendo il rumore.

Foto durante un concerto: esiste uno scenario più probante per la Modalità Notte?

Sfrutta principi simili l’Astrofotografia al debutto sui Pixel 4 che probabilmente rappresenta la maggior dimostrazione di forza compiuta da Google in tempi recenti. Questa si attiva automaticamente all’interno della Modalità Notte quando vengono rilevate condizioni di buio pressoché integrale e può spedire al Pixel Neural Core fino a 15 frame da 16 secondi ciascuno (un treppiede è d’obbligo) per un tempo di esposizione complessivo di ben 4 minuti. I risultati sono sorprendenti anche se si fatica non poco a scrollarsi di dosso l’impressione che sia la tipica funzionalità dall’effetto wow garantito ma sfruttabile poche volte durante il ciclo di vita di uno smartphone. Comunque c’è, tanto sui Pixel 4 quanto su Pixel 3 e Pixel 3a, e fa piacere averla.

Un cielo stellato catturato da Pixel 4 con Astrofotografia

Dall’introduzione della modalità Ritratto sui Pixel 2 Google Fotocamera è si è imposta come riferimento quasi inarrivabile anche sugli scatti tanto in voga negli ultimi tempi, in cui l’unico oggetto a fuoco è quello in primo piano mentre lo sfondo è sfocato. Adesso il gap con la concorrenza è meno evidente che in passato, ma ci sono degli aspetti su cui Google Fotocamera continua a svettare su buona parte della concorrenza come la possibilità di applicare il bokeh a qualsiasi soggetto, sia esso un animale o un oggetto non animato. E poco importa se il Pixel (o il vostro smartphone nel caso dei porting) possiede una sola fotocamera anteriore o posteriore: le informazioni sulla profondità di campo arrivano dal sensore dual pixel e sono elaborate con la collaborazione del machine learning, mentre i Pixel 4 beneficiano del teleobiettivo sul retro. Merita una menzione il Ritocco Viso per i selfie, attivo di default sugli ultimi Pixel, ma disattivabile oppure regolabile su due livelli: Google si è avvalsa dei consigli dei fotografi per matrimoni per giungere ad un algoritmo che riesce a rimuovere eventuali difetti sui volti inquadrati senza modificare i tratti somatici.

Ritratto da fotocamera frontale, con e senza il bokeh gestibile in post produzione

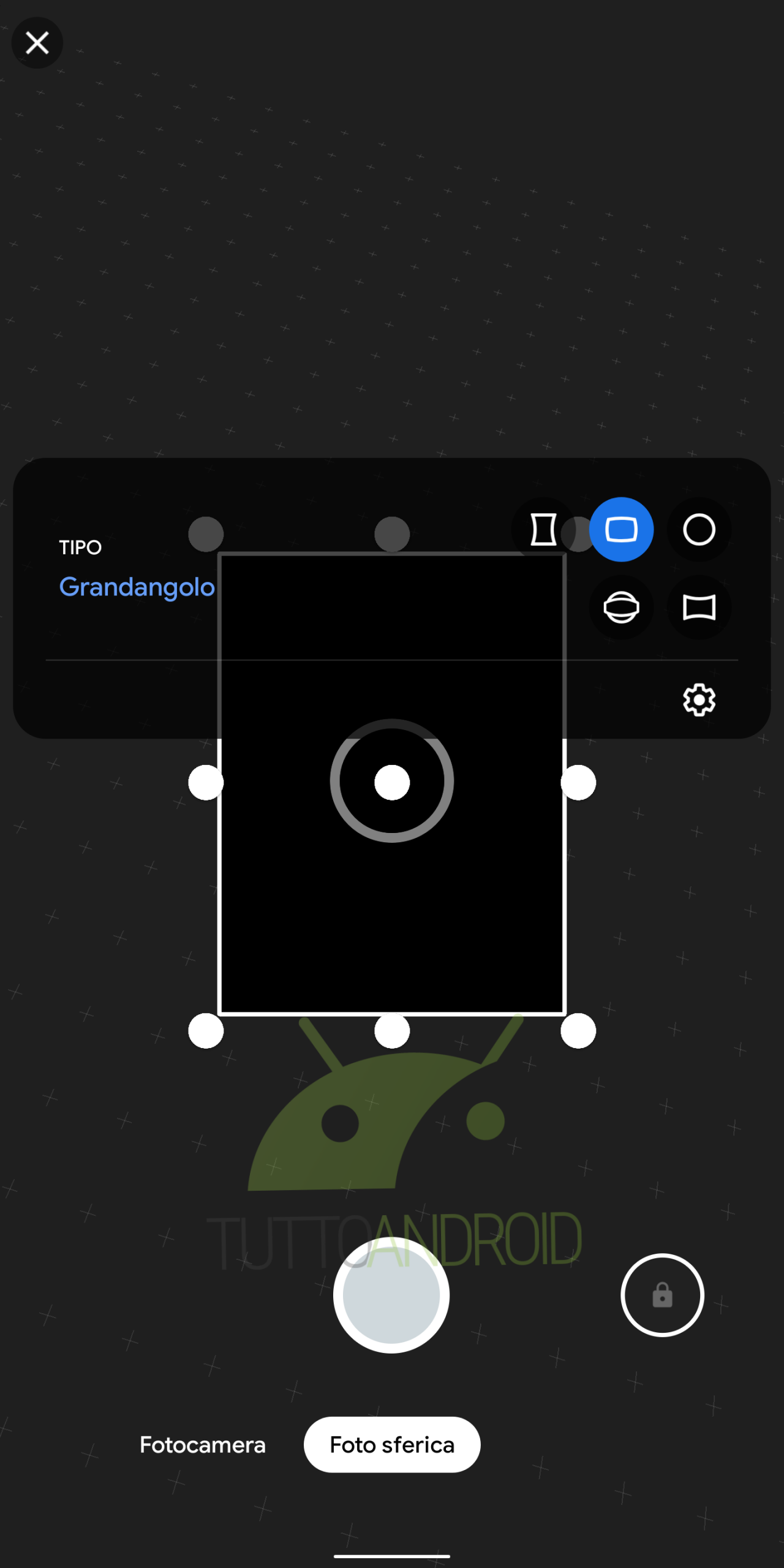

Spesso vengono ignorate (ma fidatevi, vanno provate ndr) le cinque modalità di scatto inspiegabilmente nascoste in Foto Sferica: Verticale, Orizzontale, Grandangolo, Fisheye e 360. Con un Pixel 2 XL si ottengono risultati spesso non impeccabili, ma vedete cosa può fare Grandangolo su un Pixel 4, forse per merito del nuovo Pixel Neural Core, e vi assicuriamo che per qualche attimo non rimpiangerete l’assenza di una lente dedicata: giusto il tempo di ritornare in sé e riflettere sull’impossibilità di fare video a campo largo o foto ultra-wide a soggetti in movimento, situazioni nelle quali un espediente software, per quanto ben fatto, non può nulla. Una scelta discutibile da parte di Google che fatichiamo a comprendere.

Le funzioni minori ma non troppo, come Google Lens

A partire dai Pixel 3 è stata introdotta Top Shot, funzionalità che sfrutta le brevi clip video catturate da Movimento pochi secondi prima e dopo lo scatto e che ne invia i frame (fino a 90) a Visual e Neural Core per scegliere quello meglio esposto e bilanciato. In contemporanea ha debuttato Motion Autofocus, nato per tenere a fuoco il soggetto selezionato anche se in movimento: una piccolezza, certo, ma che talvolta può fare la differenza.

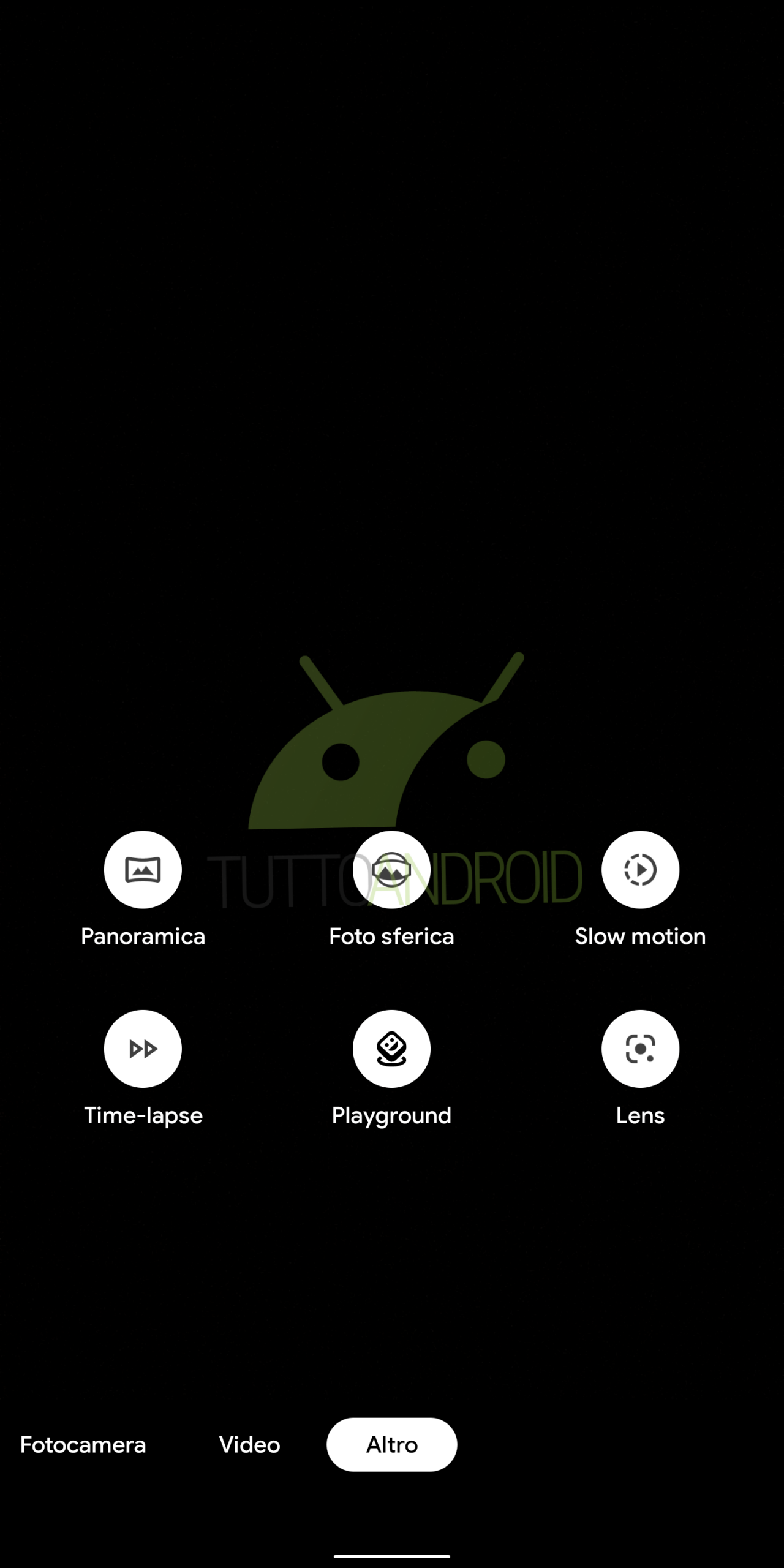

Completano l’offerta gli Slow Motion fino a 120 fps in 1080p o a 240 fps a 720p, la modalità Panoramica, Google Lens (per cui serve una trattazione a parte), il Time Lapse ed infine Playground, capace di divertire con oggetti e personaggi virtuali in realtà aumentata da includere in foto e video.

P.S. Foto e screenshot sopra, salvo dove indicato, provengono da un Google Pixel 2 XL. Gli scatti non sono stati ritoccati, solo leggermente compressi.