WhatsApp si prepara a un importante salto tecnologico, ovvero l’introduzione di strumenti basati sull’intelligenza artificiale direttamente in cloud, progettati per offrire funzionalità come il riassunto dei messaggi o l’assistenza alla scrittura, senza però compromettere la sua storica promessa di privacy e sicurezza, grazie a un nuovo sistema chiamato “Private Processing”.

Chi usa WhatsApp (circa tre miliardi di persone nel mondo), lo fa spesso proprio per la sua crittografia end-to-end, che impedisce anche a Meta di leggere i messaggi. Ma sappiamo bene che gli strumenti di intelligenza artificiale generativa, per definizione, hanno bisogno di accedere ai dati per funzionare. Ma come avranno pensato di conciliare queste due esigenze apparentemente inconciliabili?

Motorola edge 60, 8/256 GB

50+50+10MP, 6.67'' pOLED 120Hz, Batteria 5200mAh, ricarica 68W, Android 15

Private Processing e Advanced Chat Privacy: WhatsApp risponde alle preoccupazioni sulla sicurezza

La risposta di WhatsApp appare molto tecnica: si tratta di una piattaforma su misura, denominata Private Processing, che sfrutta hardware specializzato per elaborare le richieste in un ambiente isolato, il cosiddetto Trusted Execution Environment. In questo spazio protetto, i dati vengono trattati per il tempo strettamente necessario e poi eliminati. Secondo l’azienda, ciò garantirebbe che né Meta, né WhatsApp, né terze parti possano accedere a tali informazioni.

Questa mossa arriva in un momento in cui l’intelligenza artificiale è sempre più presente nei servizi digitali di ogni tipo. Come accennato qualche settimana fa, Meta ha già integrato il suo assistente IA, basato sul modello Llama, su diverse piattaforme, inclusa una scorciatoia visibile direttamente su WhatsApp. Tuttavia, molti utenti si sono mostrati scettici, poiché quel tipo di interazione sembrerebbe proprio non godere della protezione data dalla crittografia end-to-end, a differenza delle chat private. Private Processing nasce proprio per rispondere a questa diffidenza.

Chris Rohlf, direttore dell’ingegneria della sicurezza di Meta, spiega che WhatsApp ha affrontato l’introduzione dell’IA con estrema cautela: “WhatsApp è costantemente sotto osservazione da parte di ricercatori e potenziali attori malevoli. Questo significa che internamente esiste già un modello di minaccia ben definito”, ovvero l’insieme delle vulnerabilità e dei tipi di attacco possibili che vengono presi in considerazione per progettare le difese del sistema, una vera e propria mappa dei rischi su cui si fondano le strategie di sicurezza.

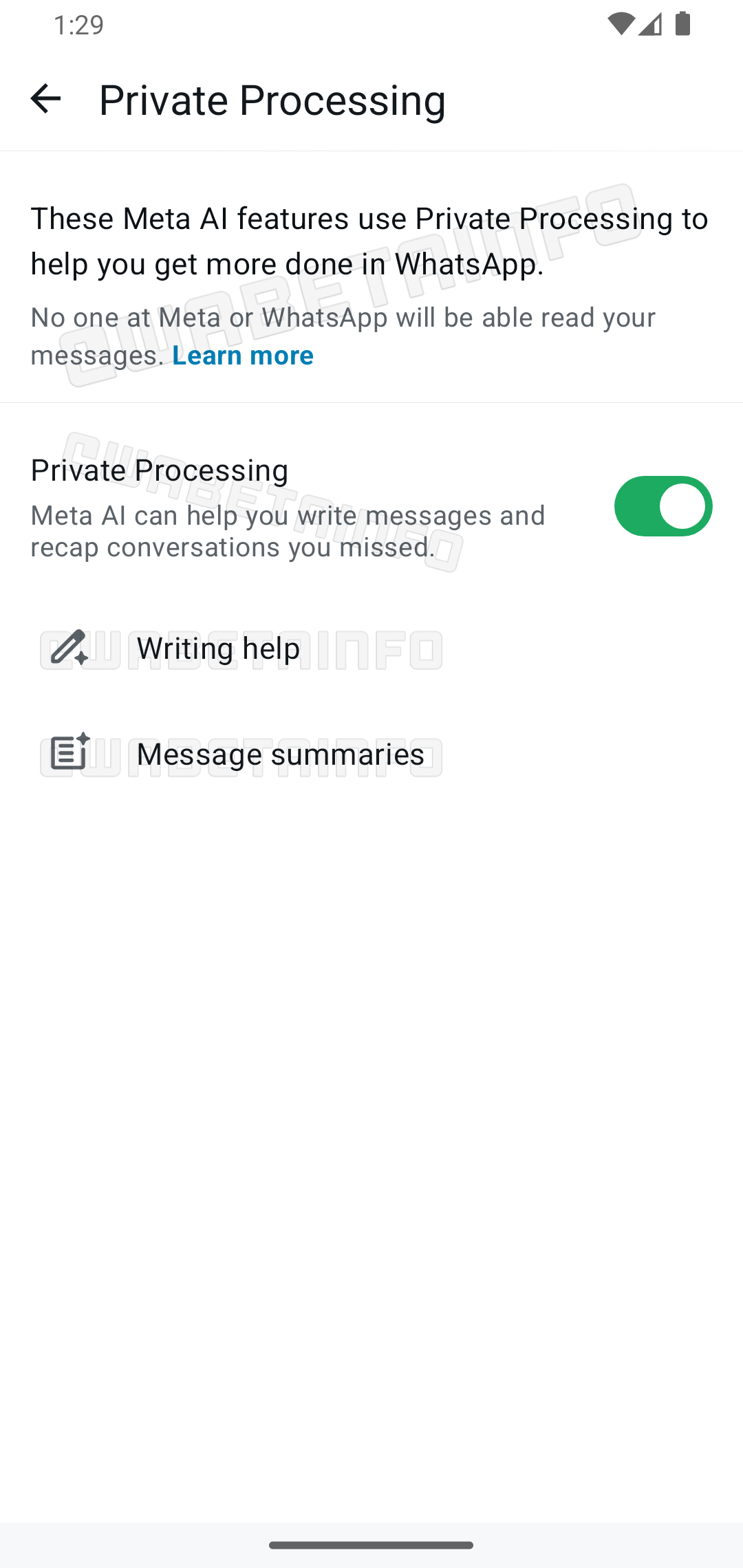

Proprio per questo, chi vorrà utilizzare le nuove funzioni basate sull’intelligenza artificiale, dovrà attivare l’opzione e potrà anche impedire che i propri interlocutori ne facciano uso in chat condivise grazie alla nuova funzione “Advanced Chat Privacy”. Insomma, è un po’ come i messaggi effimeri: tutti possono attivarli o disattivarli, e la modifica è visibile a tutti nella conversazione. Inoltre, questo nuovo sistema, bloccherà anche l’esportazione delle chat.

Perché Meta ha scelto il cloud per integrare l’intelligenza artificiale?

A differenza di Apple, che ha introdotto lo scorso anno il Private Cloud Compute per il suo sistema Apple Intelligence, Meta ha scelto un approccio diverso. Apple, controllando sia l’hardware che il software, può permettersi di eseguire gran parte delle operazioni di intelligenza artificiale direttamente sui dispositivi, mantenendo i dati e l’elaborazione al sicuro all’interno dell’ecosistema chiuso.

Meta, invece, deve fare i conti con una platea molto più ampia e diversificata, coprendo dispositivi di tutte le fasce, dai modelli più economici a quelli di fascia alta. Per questo motivo, ha optato per una soluzione basata sul cloud. Questa scelta le permette di integrare l’intelligenza artificiale in modo più flessibile, ma con un’architettura progettata per ridurre al minimo i rischi legati alla compromissione dei dati, puntando sulla sicurezza attraverso il sistema “Private Processing”.

E proprio questo è il punto dolente. Come fa notare Matt Green, esperto di crittografia alla Johns Hopkins University, ogni sistema che invia dati a un server è potenzialmente vulnerabile: “Credo a WhatsApp quando dice che non può leggere i messaggi, ma resta il fatto che più dati transitano al di fuori dei dispositivi, più quegli elaboratori diventano un bersaglio per hacker e governi”.

Meta assicura che Private Processing è solo il punto di partenza: l’idea è che in futuro possa gestire funzioni di intelligenza artificiale ancora più complesse. Ma ha davvero senso spingere così tanto sull’IA in un’app pensata, fin dall’inizio, per proteggere la riservatezza delle conversazioni?

Will Cathcart, a capo di WhatsApp, non ha dubbi: “Le persone vogliono strumenti intelligenti anche mentre scrivono messaggi. E non dovrebbero essere costrette a rinunciare alla privacy per averli.”

La privacy è un tema sempre più complicato in un mondo in cui la tecnologia avanza a passi da gigante. WhatsApp sta cercando di conciliare l’innovazione con la protezione dei dati, ma la domanda che rimane è: fino a che punto possiamo davvero fidarci delle promesse di sicurezza?

In un’era in cui ogni interazione digitale lascia tracce, può davvero esserci un equilibrio tra la comodità dell’intelligenza artificiale e la protezione totale della nostra privacy? La risposta, forse, sta nel fatto che dovremo essere sempre più consapevoli e vigili nel proteggere ciò che, forse, di più prezioso abbiamo: la nostra riservatezza. Chissà, solo il tempo ci dirà se questa fiducia è giustificata.