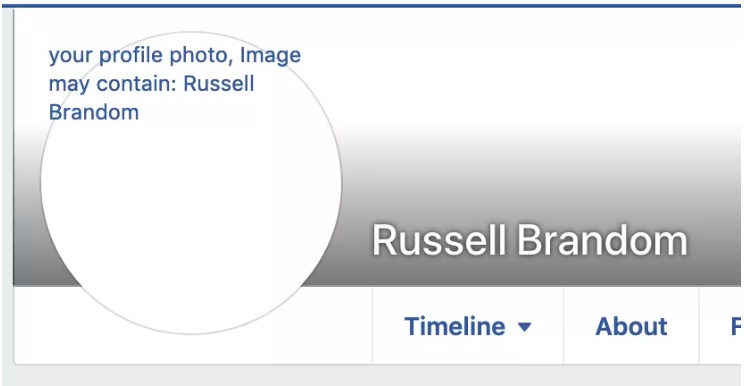

L’interruzione nella visualizzazione delle immagini che ieri ha interessato Facebook ha rivelato i tag associati a molte di esse che sono stati assegnati dai sistemi di visione artificiale dell’azienda, quindi, al posto delle foto caricate, veniva mostrato un testo del tipo “l’immagine può contenere: persone che sorridono, persone che ballano, matrimoni e interni” o semplicemente “l’immagine può contenere: un gatto”.

Gli stessi tag immagine venivano visualizzati anche su Instagram e oltre a dettagliare le descrizioni generali di scene e oggetti, suggerivano anche chi si trovava in una foto grazie alle capacità di riconoscimento facciale di Facebook.

L’accaduto ci fornisce un’idea di come l’occhio e la mente delle macchine vedono le nostre vite e di quanto siano diventati perspicaci i sistemi basati di intelligenza artificiale.

Facebook utilizza l’apprendimento automatico per “leggere” le immagini in questo modo almeno da aprile 2016 per descrivere foto e video agli utenti con problemi alla vista, tuttavia non è chiaro se Facebook utilizzi queste informazioni anche per indirizzare gli annunci.

I miglioramenti nel deep learning hanno rivoluzionato il mondo della visione artificiale e il contenuto visivo online è spesso leggibile dalle macchine come testo e ciò facilita raccogliere, analizzare e archiviare dati. È solo quando il sistema si inceppa, come accaduto ieri, che ci rendiamo conto di cosa sta accadendo dietro le quinte.