Il riconoscimento degli elementi di un’immagine è una sfida in cui Google si impegna da tempo con risultati sempre più soddisfacenti. Quest’oggi un post sul Google Research Blog alza l’asticella ancora più in alto grazie ad un nuovo traguardo raggiunto dal team di ricerca: 94% di precisione nell’analisi e descrizione degli oggetti.

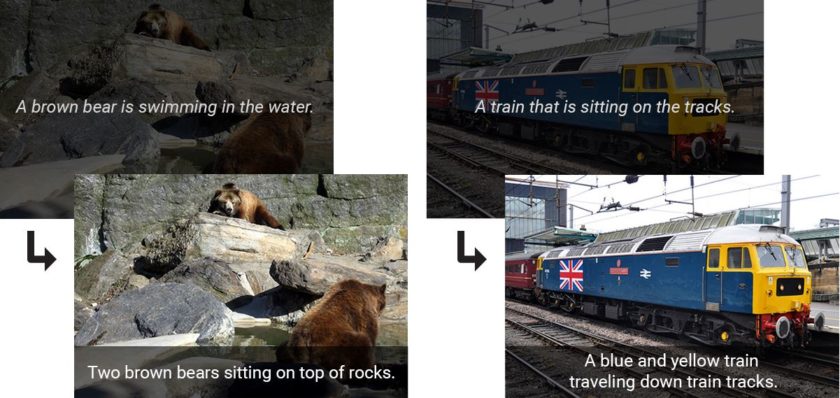

Forse anche grazie all’acquisizione di Moodstocks, ora Google Brain può vantare il riconoscimento di (quasi) tutto ciò che è stato immortalato in una foto correlando i singoli elementi e tenendo conto anche del colore. L’immagine di copertina in alto è un semplice esempio dell’evoluzione del sistema dal 2014 ad oggi.

Come ha affermato Chris Shallue, Software Engineer nel team che lavora su Google Brain:

Il modello di classificazione riconoscerà non solo un cane, un prato ed un frisbee nell’immagine ma dovrebbe essere capace di dire di che colore è il prato e come il cane è posto nei confronti del frisbee.

Dietro tutto questo c’è ancora lo zampino di TensorFlow: il team di sviluppo ha cercato di “istruire” il sistema “mostrando centinaia di migliaia di immagini descritte manualmente da persone e si è servito di esse come base per situazioni simili a quelle già analizzate dall’occhio umano“. Sotto potete trovare un’immagine che spiega questa fase, denominata fine-tuning.

![]()

Il sistema, tuttavia, non elabora e riporta semplicemente una didascalia in base al lavoro fatto dall’uomo ma riesce a creare descrizioni del tutto inedite collegando elementi ed unendoli tra loro in una frase di senso compiuto: Google Foto è solo la punta dell’iceberg!

![]()

La tecnologia di TensorFlow è open source su GitHub e potete spulciarla per progetti personali o per curiosità semplicemente cliccando qui.

Vi interessa questa branca del machine learning e delle intelligenze artificiali?